海量数据存储基础 数据存储技术的演进、挑战与未来

在当今数字化时代,数据已成为驱动社会进步和商业创新的核心生产要素。从社交媒体上的每一条动态,到工业传感器采集的实时监控信息,再到科学研究中的天文观测数据,我们正以前所未有的速度生成着海量信息。如何高效、安全、可靠地存储这些数据,构成了现代信息技术的基础支柱。本文将探讨海量数据存储的基础概念、核心技术、面临挑战及未来发展趋势。

一、 海量数据存储的核心概念

海量数据存储,通常指应对PB(Petabyte,千万亿字节)乃至EB(Exabyte,百亿亿字节)级别数据量的存储系统。其核心目标不仅是简单地“存下”数据,更要确保数据的可访问性、一致性、持久性与安全性。与传统的企业级存储相比,海量数据存储系统需要具备横向扩展(Scale-Out) 能力,即能够通过增加标准化的硬件节点来近乎线性地提升存储容量和性能,而非依赖单一、昂贵的高端设备进行纵向升级(Scale-Up)。

二、 关键技术架构与模式

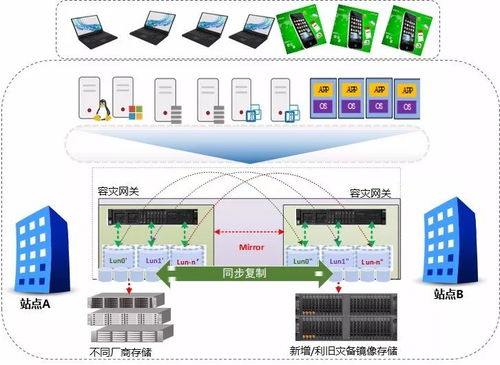

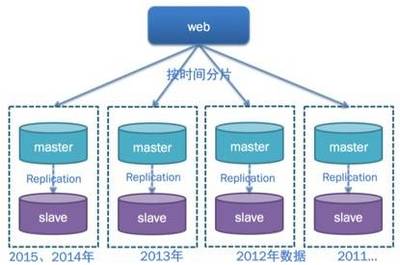

- 分布式存储系统:这是海量数据存储的基石。系统将数据分割成块,分散存储在网络互联的多个普通服务器节点上。典型代表如HDFS(Hadoop Distributed File System) 和Ceph。它们通过冗余副本(通常是3份)机制来保证数据可靠性,即使部分节点失效,数据依然可用。

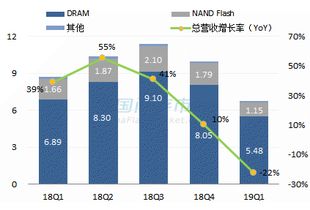

- 存储介质演进:存储硬件是承载数据的物理基础。

- 硬盘驱动器(HDD):凭借高容量和低成本优势,仍是冷数据和大容量存储的主力。

- 固态硬盘(SSD):以其极高的IOPS(每秒输入输出操作次数)和低延迟,成为处理热数据(频繁访问)的关键,广泛应用于数据库、缓存等场景。

- 新兴介质:如NVMe(非易失性内存主机控制器接口规范) 协议和SCM(存储级内存,如英特尔傲腾) 进一步模糊了内存与存储的界限,为极致性能需求打开新大门。

- 存储分层与数据生命周期管理:根据数据的访问频率和重要性,将其自动迁移到不同性能/成本的存储层,实现成本与效率的最优平衡。例如,热数据存于SSD,温数据存于高性能HDD,冷数据则归档至磁带库或低成本对象存储。

- 软件定义存储(SDS):将存储的控制软件(如数据管理、冗余、快照等功能)与硬件解耦,通过软件来实现灵活的存储策略和管理,降低了对专用硬件的依赖,提升了系统的敏捷性和可扩展性。

- 对象存储:与传统的文件系统(树状结构)和块存储(原始磁盘块)不同,对象存储将数据、元数据和一个全局唯一标识符打包为一个“对象”,扁平化管理。它非常适合存储图片、视频、备份归档等非结构化海量数据,Amazon S3、阿里云OSS是其云上的典型服务。

三、 面临的主要挑战

- 成本压力:海量数据意味着巨大的硬件投入和持续的电力、冷却、机房空间等运维成本。如何在保证性能与可靠性的前提下降低总拥有成本(TCO)是永恒课题。

- 数据安全与合规:数据泄露、勒索软件攻击风险剧增。GDPR等数据隐私法规要求数据存储必须满足地域性、可删除性等合规要求,增加了存储架构设计的复杂性。

- 性能与规模的平衡:随着节点数量增加,数据一致性维护、网络延迟、元数据管理开销会显著上升,如何保持系统整体的高性能是一大挑战。

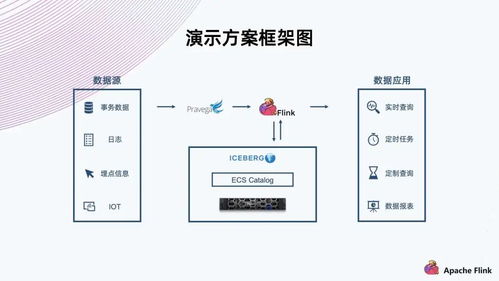

- 数据价值挖掘:存储的最终目的是使用。如何让海量数据“活”起来,方便AI分析、实时查询,而不仅仅是“沉睡”在硬盘里,对存储系统的数据接口和访问模式提出了新要求。

四、 未来发展趋势

- 存储与计算融合:为避免数据在存储和计算单元间迁移产生巨大开销,存算一体架构正受到关注,旨在将部分计算能力下沉到存储节点,就近处理数据。

- AI赋能的智能存储:利用机器学习算法预测数据访问模式,实现更精准的自动分层、故障预测和性能优化,使存储系统更加自治、高效。

- 云原生存储:专为容器化和微服务架构设计的存储方案,具备敏捷部署、弹性伸缩和声明式API等特点,成为云上应用的标准配置。

- 可持续性与绿色存储:通过高密度硬件、液冷技术、更高效的纠删码算法(相比多副本降低冗余度)等手段,降低数据中心的能耗和碳足迹。

###

海量数据存储早已超越了“仓库”的单一角色,正演变为一个智能、敏捷、安全的数据基础设施平台。它不仅是数字世界的记忆体,更是激活数据价值、赋能上层应用的基石。面对持续爆炸式增长的数据洪流,唯有不断创新存储技术、优化架构设计,才能夯实数字时代的根基,让数据真正成为取之不尽、用之不竭的宝贵资源。

如若转载,请注明出处:http://www.wzswzz.com/product/16.html

更新时间:2026-04-30 22:14:59